2024 оны 12-р сард Хятадын DeepSeek баг нэг зүйл хийсэн. 671 тэрбум параметртай модель бүтээгээд, сургалтын зардал нь $5.5 сая гэж зарласан. GPT-4-ийн зардал $100 сая орчим гэж тооцоолдог. Benchmark-ийн оноогоор бараг ижил. Зарим дээр илүү. Яаж?

Энэ бол маркетингийн нэхэмжлэл биш. Техникийн цаад шийдлүүд нь нийтлэгдсэн, нээлттэй, хэн ч унших боломжтой. Энэ нийтлэлд би тэдгээрийг задалж, Америкийн загваруудтай хэрхэн ялгаатай болохыг тайлбарлана.

Яриагаа тодорхой тоонуудаас эхлэх нь зүйтэй. Үүний дараа яагаад ийм ялгаатай болохыг техникийн талаас нь задлана.

| Загвар | Сургалтын зардал | GPU цаг | Чип |

|---|---|---|---|

| DeepSeek-V3 | $5.5 сая | 2.78 сая цаг | 2,048x H800 |

| Llama 3.1 405B | ~$92-123 сая | 30.8 сая цаг | 16,000x H100 |

| GPT-4 | ~$50-100+ сая | Тодорхойгүй | ~25,000x A100 |

Нэг зүйлийг тодруулах хэрэгтэй. DeepSeek-ийн $5.5 сая гэдэг тоо нь зөвхөн эцсийн амжилттай сургалтын compute зардал. Өмнөх туршилтууд, R&D, цалин, дэд бүтцийн зардлыг оруулаагүй. Бүгдийг нийлүүлбэл $10-20 сая орчим болно гэж тооцоолдог. Гэхдээ тэр ч гэсэн GPT-4-ийн 5-10 дахин бага.

Тэгэхээр 671 тэрбум параметртай загвар токен бүрд ердөө 37 тэрбумыг л идэвхжүүлдэг. 5.5 хувь. Үлдсэн 94.5% нь унтаж байна. Яаж ийм юм боломжтой вэ?

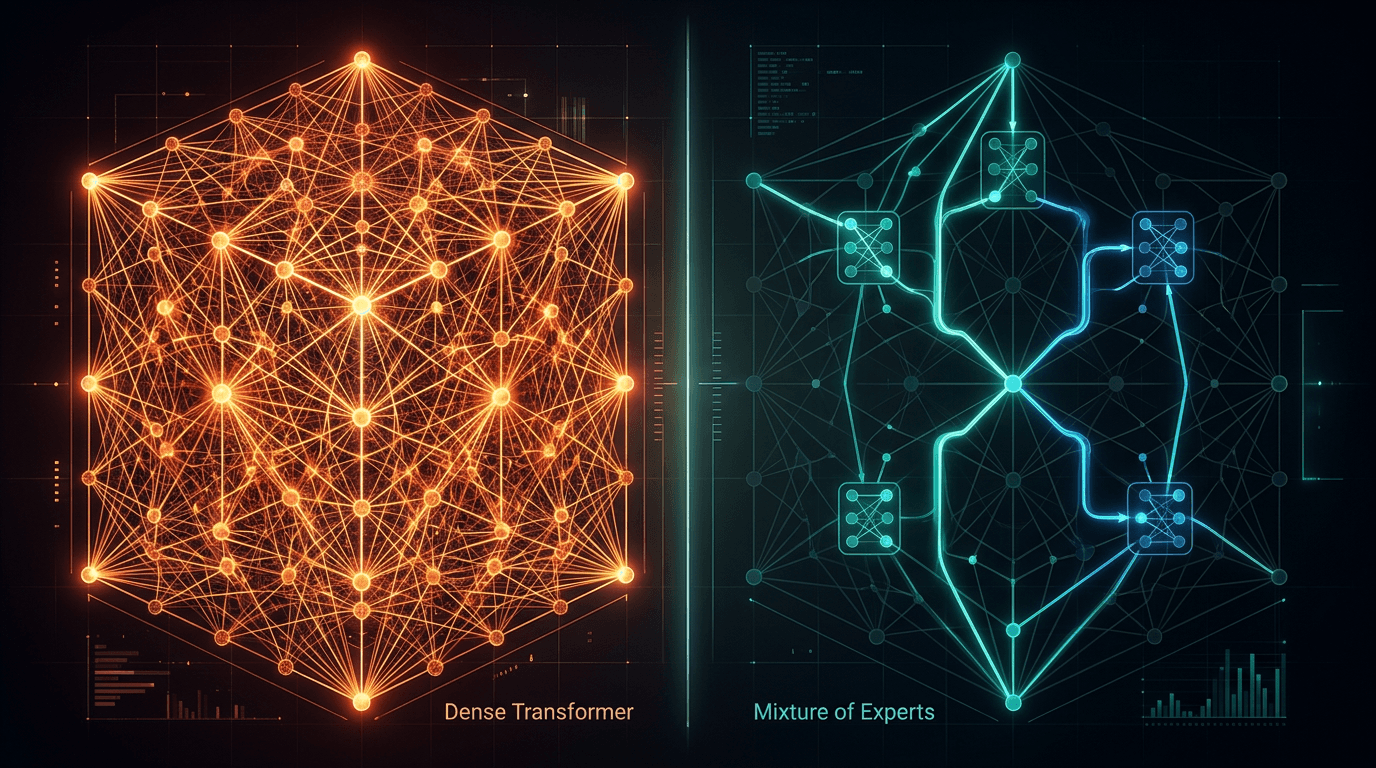

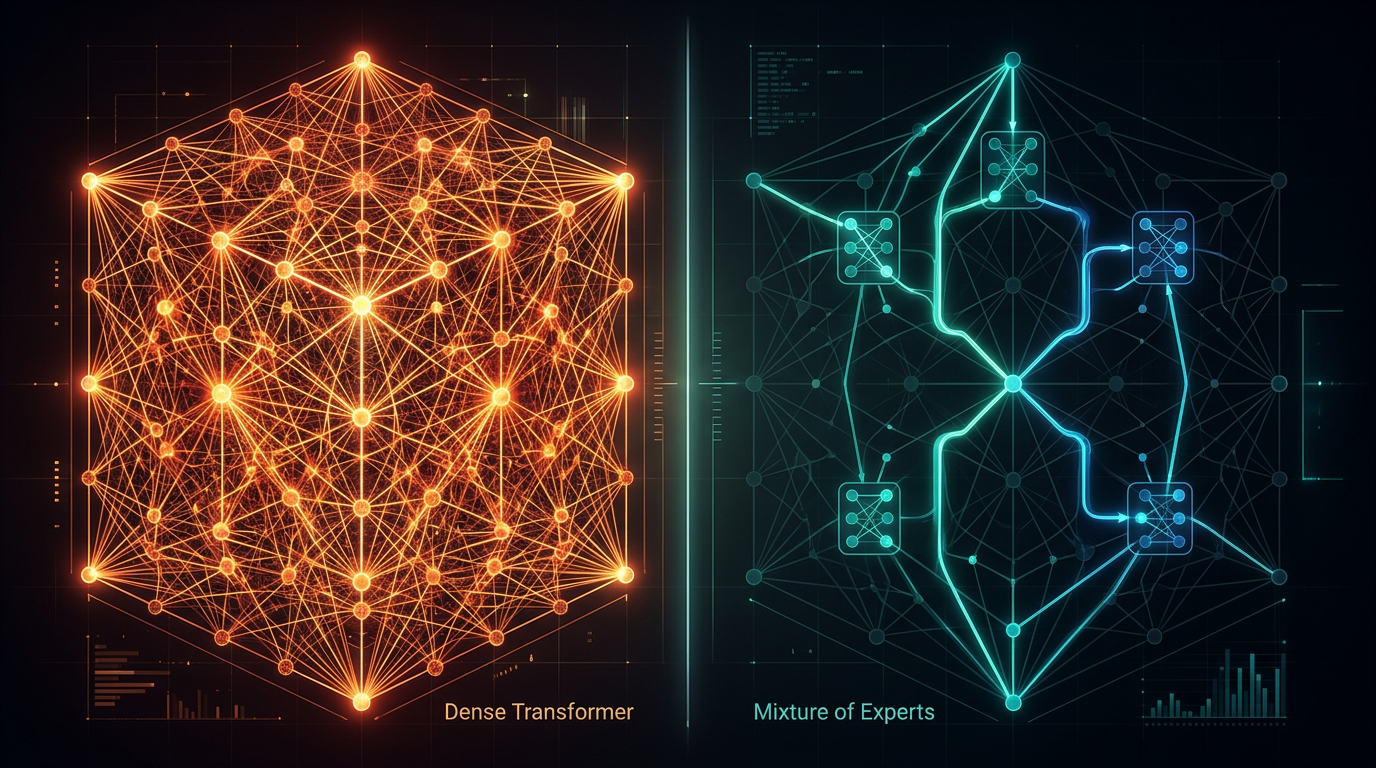

Америкийн анхны том загварууд (GPT-3, GPT-4-ийн нэг хувилбар, Claude, Llama) дийлэнхдээ dense transformer архитектур дээр суурилсан. Энэ нь токен бүрд загварын бүх параметр идэвхждэг гэсэн үг. 405 тэрбум параметртай бол токен бүрд 405 тэрбум параметр ажилладаг.

DeepSeek өөр замаар явсан. DeepSeekMoE гэж нэрлэсэн архитектур нь олон жижиг "expert" сүлжээнүүдийг нэг загварт нэгтгэдэг. Токен ирэхэд router сүлжээ нь тухайн токенд хамгийн тохиромжтой цөөн хэдэн expert-ийг сонгож идэвхжүүлдэг. Бусад expert-ууд ажиллахгүй.

Dense Transformer

GPT-4, Claude, LlamaБүх параметр, токен бүрд идэвхждэг. Хялбар, тогтвортой. Гэхдээ маш их compute шаарддаг. 405B загвар = токен бүрд 405B параметрын тооцоолол.

DeepSeekMoE

DeepSeek-V2, V3Expert-уудыг нарийн хуваасан. Shared expert нь бүх токенд хэрэглэгдэж, routed expert-уудаас зөвхөн цөөхнийг сонгодог. 671B загвар, гэхдээ токен бүрд ердөө 37B.

Auxiliary-loss-free load balancing

MoE-ийн хамгийн том асуудал нь зарим expert олон токен авч, зарим нь огт ажилгүй суух явдал. Өмнөх MoE загварууд (Mixtral гэх мэт) үүнийг шийдэхийн тулд auxiliary loss нэмдэг — expert-уудыг жигд ачаалахыг албадах шийтгэлийн функц.

Гэхдээ энэ нэмэлт loss нь загварын гол чанарыг бууруулдаг. DeepSeek үүнийг бүрэн арилгасан. Тэд auxiliary loss-гүйгээр load balancing хийдэг шинэ арга зохиосон. Expert-уудын ачааллыг bias term-ээр динамикаар зохицуулдаг, загварын суралцах чадварт саад болохгүйгээр.

MoE нь шинэ зүйл биш — Google-ийн Switch Transformer, Mistral-ийн Mixtral бүгд ашигласан. Гэхдээ DeepSeek-ийн хэрэгжүүлэлт хамгийн нарийн. Expert-уудыг бусдаас жижиг, олон болгосон нь илүү нарийвчлалтай routing хийх боломж өгсөн.

Transformer загваруудын хамгийн том inference-ийн саад бол KV cache. Загвар текст үүсгэх бүрд өмнөх токен бүрийн Key, Value утгуудыг санах ойд хадгалах шаардлагатай. Контекст урт болох тусам энэ cache асар их санах ой зарцуулдаг.

Америкийн загварууд үүнийг хэрхэн шийддэг вэ? Llama 2, 3 нь Grouped Query Attention (GQA) ашигладаг. Олон query head нэг K, V head-ийг хуваалцдаг. Ингэснээр KV cache-ийг ойролцоогоор 87.5% хүртэл бууруулдаг. Сайн шийдэл.

DeepSeek өөр замаар явсан. Multi-head Latent Attention (MLA) нь KV cache-ийг бүхэлд нь бага хэмжээст latent vector руу шахдаг. K, V утгуудыг тус тусдаа хадгалахын оронд нэг жижиг вектор хадгалаад, хэрэгтэй үедээ задлан гаргадаг.

Энэ нь inference-ийн зардалд шууд нөлөөлдөг. Санах ой бага зарцуулна гэдэг нь нэг GPU дээр илүү олон хэрэглэгчийн хүсэлтийг зэрэг боловсруулна гэсэн үг. API-ийн зардал буурна.

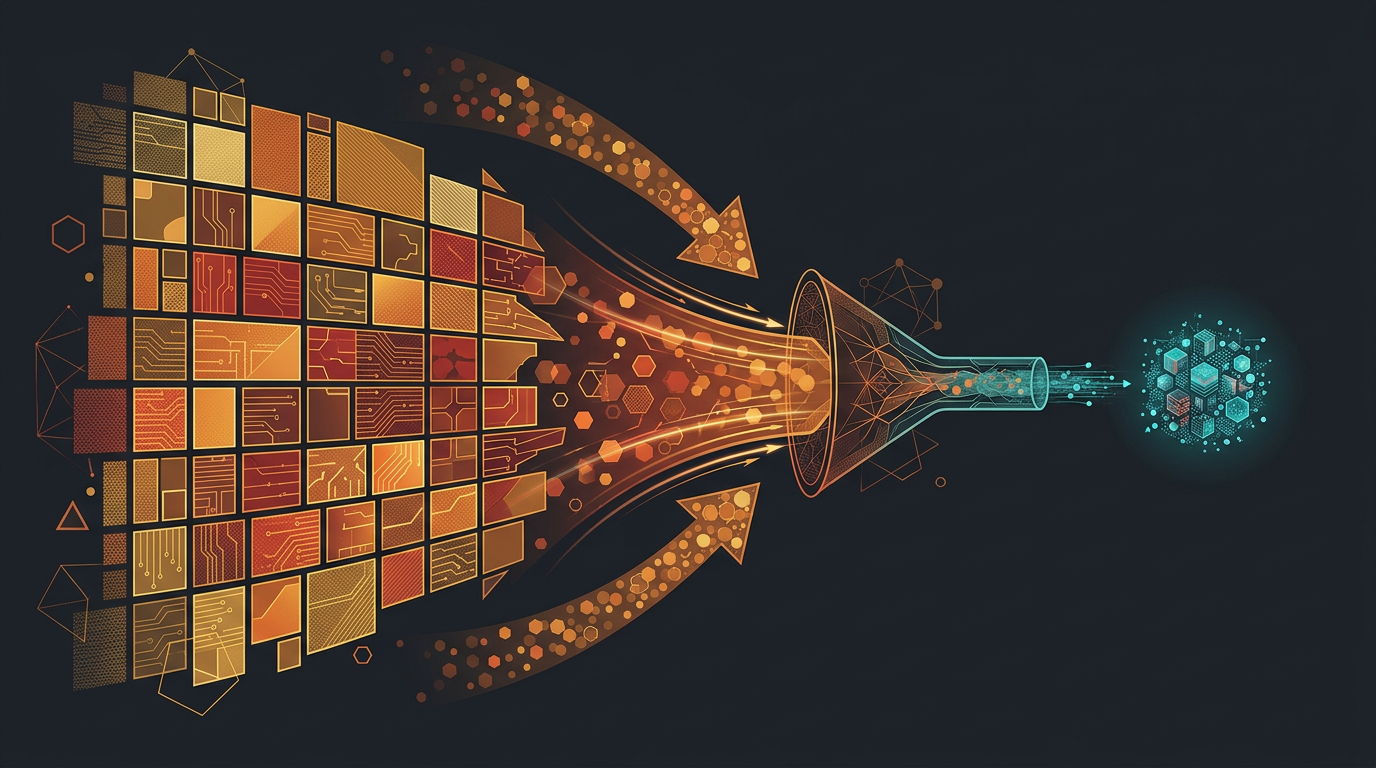

Архитектур зөвхөн загварын дизайны тухай. Сургалтын процесс өөрөө ч адил чухал, магадгүй бүр илүү. DeepSeek сургалтын pipeline-даа хэд хэдэн шинэлэг зүйл нэвтрүүлсэн.

FP8 Mixed Precision сургалт

Ихэнх Америкийн загварууд BF16 (16-bit) нарийвчлалаар сургагддаг. DeepSeek-V3 нь FP8 (8-bit) нарийвчлалаар сургагдсан хамгийн том загвар болсон.

8-bit нь 16-bit-ийн хагас хэмжээтэй. Ингэснээр санах ойн хэрэглээ хоёр дахин буурч, тооцооллын хурд хоёр дахин нэмэгддэг. Гэхдээ нарийвчлал буурахгүй юу? DeepSeek-ийн хариулт: fine-grained quantization ба high-precision accumulation хослуулснаар чанарын алдагдалгүйгээр FP8 сургалт хийж болно гэдгийг батлав.

Энд бүхэл нэг түүх бий. АНУ-ын экспортын хязгаарлалтаас болж Хятадын компаниуд Nvidia-ийн хамгийн сайн H100 чипийг авч чаддаггүй. Оронд нь H800 гэсэн "зөөлрүүлсэн" хувилбарыг ашигладаг.

H800 нь H100-тай compute хүч нь яг ижил — хоёулаа FP8 дээр 2000 TFLOPS. Гэхдээ GPU хоорондын холбооны зурвасын өргөн нь огтлогдсон. H100 нь 900 GB/s, H800 нь 400 GB/s. Бараг тал нь.

MoE загварын хувьд энэ онцгой асуудал. Expert-ууд өөр өөр GPU дээр байдаг, тэд хоорондоо байнга дата солилцох шаардлагатай. Холбооны зурвас нарийн бол бүх процесс удааширна.

DeepSeek яаж шийдсэн бэ?

- Expert-уудыг хамт идэвхждэг бүлгүүдээр нь ижил 8-GPU node дотор байршуулсан. Ингэснээр дата солилцлын 80% нь хурдан NVLink-ээр явдаг, зөвхөн 20% нь удаан InfiniBand-аар.

- DualPipe гэсэн pipeline parallelism framework зохиосон. Forward ба backward тооцооллыг жижиг хэсгүүдэд хуваагаад, тооцоолол ба дата дамжуулалтыг яг зэрэг ажиллуулдаг. GPU хүлээж сууж байгаа хугацаа бараг тэг.

- CUDA-аас доош PTX түвшинд програмчилж, H800-ийн 132 streaming multiprocessor-оос 20-ийг нь зөвхөн GPU хоорондын холбоо дамжуулахад зориулсан. Бусад 112 нь зөвхөн тооцоолол хийдэг.

Хязгаарлалт яагаад сайн зүйл байж болох вэ?

H100-тай бол илүү өргөн зурвас байна, тиймээс оновчлолын хэрэгцээ бага. Илүү их GPU, илүү их мөнгө шиднэ. H800-тай бол зурвасын өргөн хязгаарлагдмал, тиймээс DualPipe, expert placement, PTX-level optimization шиг бүтээлч шийдлүүд заавал хэрэгтэй болсон. Хязгаарлалт нь инновацийг албадсан.

DeepSeek-R1 нь reasoning чадвартай загвар. OpenAI-ийн o1-тэй өрсөлддөг. Гэхдээ сургах арга нь огт өөр.

OpenAI, Anthropic нарын RLHF (Reinforcement Learning from Human Feedback) процесс нь хүний үнэлгээчид хэрэгтэй. Олон мянган хариултыг хүмүүс чансаалж, тэр дата дээр reward model сургаж, дараа нь тэр reward model-оор загвараа fine-tune хийдэг. Үнэтэй, удаан.

DeepSeek-R1 нь GRPO (Group Relative Policy Optimization) ашигладаг. Арга нь:

- Нэг prompt-д олон хариулт үүсгэнэ (бүлэг бүрдүүлнэ)

- Хариулт бүрийг rule-based reward-аар үнэлнэ. Математикийн бодлого бол хариулт зөв эсэхийг шалгана. Код бол test pass хийх эсэхийг шалгана.

- Бүлэг дотор хариултуудыг хоорондоо харьцуулж, харьцангуй оноо өгнө

- Тусдаа critic/value model хэрэггүй — PPO-оос ялгаатай нь санах ойн зардал бага

Хүний тэмдэглэл хэрэггүй. Тусдаа reward model хэрэггүй. Critic model хэрэггүй. Гурван зүйлийг хасахад зардал мэдэгдэхүйц буурна.

Бас нэг сонирхолтой зүйл — DeepSeek-R1 цэвэр RL-ээр сургагдах явцад self-reflection, verification, strategy switching зэрэг чадварууд аяндаа гарч ирсэн. Хүн тусгайлан заагаагүй, загвар өөрөө олсон. Тэгээд тэр чадваруудыг жижиг загваруудад distillation-аар шилжүүлсэн — DeepSeek-R1-Distill цуврал.

Энэ бүх оновчлол ямар бодит үр дүнд хүрсэн бэ? DeepSeek-V3-ийн Chat загварын benchmark оноог Llama 3.1 405B, Claude 3.5 Sonnet, GPT-4o-тэй харьцуулъя.

| Benchmark | DeepSeek-V3 | GPT-4o | Claude 3.5 | Llama 405B |

|---|---|---|---|---|

| MMLU | 88.5 | 87.2 | 88.3 | 88.6 |

| MATH-500 | 90.2 | 74.6 | 78.3 | 73.8 |

| HumanEval-Mul | 82.6 | 80.5 | 81.7 | 77.2 |

| AIME 2024 | 39.2 | 9.3 | 16.0 | 23.3 |

| Codeforces | 51.6 | 23.6 | 20.3 | 25.3 |

| LiveCodeBench | 40.5 | 33.4 | 36.3 | 28.4 |

| Arena-Hard | 85.5 | 80.4 | 85.2 | 69.3 |

Математик, код бичих даалгаварт DeepSeek-V3 бусдаас тод ялгарч байна. AIME 2024 дээр GPT-4o-оос 4 дахин илүү, Codeforces дээр Claude 3.5-аас 2.5 дахин илүү оноо. Ерөнхий мэдлэг (MMLU) дээр дөрвүүлээ бараг ижил.

Тэгээд дахин сануулъя — энэ бүхэн $5.5 сая зардалтай.

Техникийн ялгааны цаана стратегийн том ялгаа бий.

Хятадын лабууд (DeepSeek, Alibaba/Qwen) загвараа нээлттэй тавьдаг. Жин нь HuggingFace дээр байна, техникийн тайлан нь arXiv дээр байна, хэн ч татаж ажиллуулж болно. SGLang, vLLM зэрэг нээлттэй framework-уудтай шууд хамтарч ажилладаг.

Америкийн тэргүүлэгч лабууд (OpenAI, Anthropic, Google) загвараа API-аар л өгдөг. Архитектурын дэлгэрэнгүйг нийтэлдэггүй (GPT-4-ийн параметрын тоо ч албан ёсоор мэдэгдээгүй). Meta-ийн Llama цуврал нь үл хамаарах жишээ — Америкийн компаниас нээлттэй загвар.

Хятадын стратеги

Нээлттэй эх, хурдан давталтЗагвар нээлттэй, олон нийт сайжруулна, хурдан хөгжинө. Developer community-ийг татах, дэлхий даяар тархах. Олон мэргэжилтэн саналаа оруулснаар хурдтай iteration бий болно.

Америкийн стратеги

Хаалттай API, бизнес давуу талЗагвар хаалттай, бизнесийн давуу тал хамгаалагдана. Аюулгүй байдлын хяналт илүү, гэхдээ гаднын хүмүүс сайжруулах боломжгүй. Ашиг олох загвар илүү тодорхой.

Нэг шидэт шийдэл байхгүй. Олон шинэчлэл хоорондоо нэмэлцэж, нийлбэр нь асар их ялгаа үүсгэсэн.

- MoE архитектур — 671B параметрын 5.5%-ийг л идэвхжүүлж, 37B-ийн compute-оор 671B-ийн мэдлэгийг ашигладаг

- MLA — KV cache-ийг 93% бууруулж, inference-ийн санах ой ба зардлыг огцом бууруулсан

- FP8 сургалт — 16-bit-ийн оронд 8-bit ашиглаж, compute хурдыг хоёр дахин нэмэгдүүлсэн

- DualPipe — тооцоолол ба дата дамжуулалтыг зэрэг явуулж, GPU-ийн сул зогсолтыг бараг тэглэсэн

- Auxiliary-loss-free load balancing — expert-уудыг жигд ачаалахдаа загварын чанарыг бууруулдаггүй

- GRPO — хүний тэмдэглэл, reward model, critic model-гүйгээр reinforcement learning хийдэг

- PTX-level GPU оновчлол — H800-ийн зурвасын хязгаарлалтыг доод түвшний програмчлалаар тойрсон

Нэг нэгээр нь авбал энэ бүгд ойлгомжтой оновчлолууд. Гэхдээ бүгдийг нь нэг загварт нэгтгэж, 14.8 триллион токен дээр тогтвортой сургаж чадсан нь жинхэнэ ур чадвар.

Энэ нийтлэлийн судалгааг DeepSeek-V3, DeepSeek-V2, DeepSeek-R1, Qwen2, DeepSeekMoE зэрэг техникийн тайлан, 73 нэмэлт эх сурвалж дээр тулгуурлан хийсэн. Хятадын LLM хөгжүүлэлт нь мөнгө цацах бус, инженерийн оновчлолоор ялгарч байна. Энэ чиг хандлага цаашид хэрхэн өөрчлөгдөхийг мэдэхийн аргагүй, гэхдээ одоогоор тоонууд өөрсдөө ярьж байна.